富士通推出GPU自适应分配技术 驱动异构计算资源智能优化

随着人工智能、高性能计算及复杂模拟应用的快速发展,CPU与GPU的协同效率已成为制约计算系统性能的关键因素。日本科技巨头富士通(Fujitsu)宣布推出一项创新的GPU自适应分配技术,旨在通过动态智能调度,实现CPU与GPU资源的更合理分配,从而提升整体系统的能效与计算性能。这一技术突破有望为数据中心、云计算及边缘计算等场景带来显著的效率优化。

技术背景与挑战

在传统异构计算架构中,CPU负责通用逻辑处理与任务调度,而GPU则专注于并行计算与图形处理。固定或手动配置的资源分配模式往往导致两种核心处理器之间的负载不均衡:一方面,GPU可能在空闲时段未能充分利用其强大的并行能力;另一方面,CPU在面临高密度计算任务时可能因资源不足而成为瓶颈。这不仅降低了硬件利用率,还增加了能耗与运营成本。

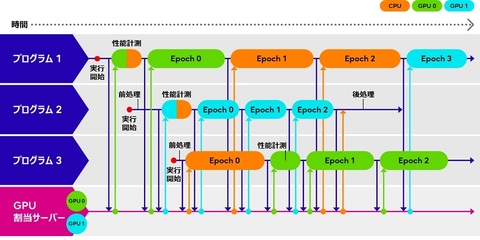

富士通的GPU自适应分配技术正是针对这一痛点而生。该技术通过实时监控应用程序对计算资源的需求,结合机器学习算法预测负载变化,自动调整CPU与GPU之间的任务分配比例。例如,在AI模型训练期间,系统可动态将更多计算密集型任务迁移至GPU,而在数据预处理阶段,则优化CPU的调度策略,确保资源利用最大化。

技术核心优势

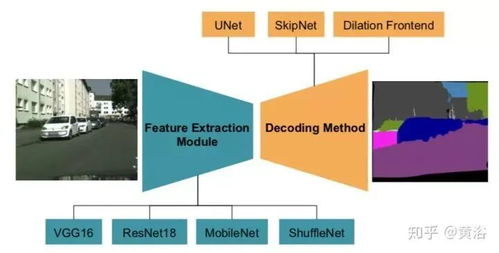

- 动态自适应调度:该技术无需人工干预,可根据工作负载特征实时调整资源分配。通过内置的智能感知模块,系统能够识别任务类型(如深度学习推理、科学模拟或实时渲染),并匹配最优的处理器组合。

- 能效显著提升:实验数据显示,在典型的高性能计算场景中,该技术可将整体能耗降低约15%-20%,同时保持或提升任务处理速度。这对于追求绿色计算的数据中心而言具有重要意义。

- 兼容性与可扩展性:富士通表示,该技术可适配多种硬件平台,包括其自有的A64FX处理器(曾用于富岳超级计算机)及主流GPU架构(如NVIDIA与AMD方案),并能无缝集成至现有云计算管理框架中。

- 降低运营复杂度:通过自动化资源管理,企业无需依赖专业工程师进行繁琐的手动调优,从而减少运维成本与人为错误风险。

应用前景与行业影响

GPU自适应分配技术的推出,正值全球计算产业向异构化、智能化转型的关键时期。在以下领域,该技术预计将发挥重要作用:

- 云服务与数据中心:帮助云服务提供商(如AWS、Azure)优化虚拟机与容器资源的分配,提升多租户环境下的服务品质与资源隔离效率。

- 人工智能与边缘计算:在自动驾驶、工业物联网等实时性要求高的场景中,通过动态分配边缘设备的CPU/GPU资源,可加速本地推理过程并减少延迟。

- 科学研究与工程模拟:气候建模、基因测序等大规模并行计算任务将受益于更灵活的硬件调度,缩短实验周期并降低计算成本。

未来展望

富士通计划在未来一年内将该技术整合至其服务器产品线及云解决方案中,并开放部分API供开发者定制化使用。行业分析指出,随着算力需求持续爆炸式增长,此类智能资源管理技术将成为下一代计算基础设施的核心竞争力之一。

富士通的GPU自适应分配技术不仅代表了硬件资源管理的一次重要革新,也为构建高效、可持续的计算生态系统提供了新思路。在数字化转型浪潮中,此类技术创新或将重新定义计算效率的边界,助力各行业应对日益复杂的算力挑战。

如若转载,请注明出处:http://www.kdbushimao.com/product/30.html

更新时间:2026-05-27 08:58:00